电话:400-6368-3518

地址:山东潍坊

原标题:H100最强竞品正式对外发布!推理快1.6倍,内存高达192GB,来自AMD

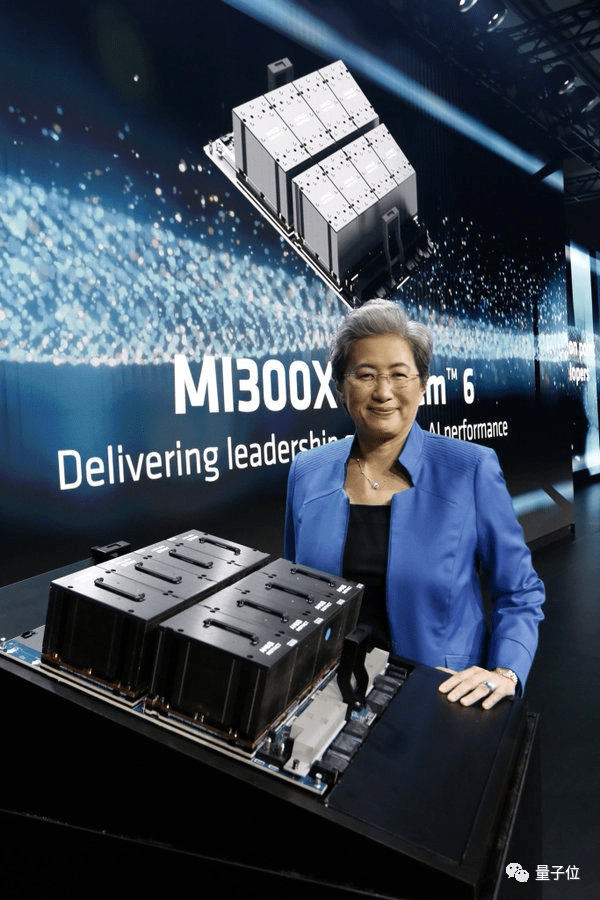

包括1530亿个晶体管,AI使命推理功能比H100快1.6倍,内存容量足足192GB,是H100的两倍以上(2.4x)。

音讯称,微软、Meta、OpenAI和Oracle等一众公司已首先许诺将购买AMD的这款GPU来代替H100。

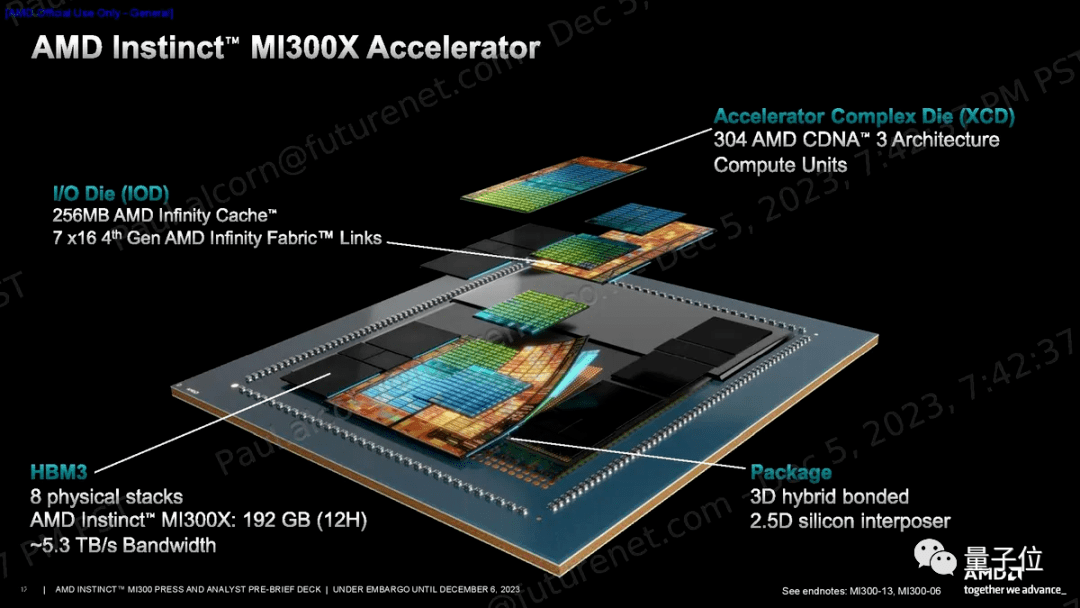

据介绍,Instinct MI300X是AMD运用有史以来最先进的生产技术打造,是Chiplet规划办法的“代表之作”。

终究制品功耗750W,包括304个核算单元、5.3TB/s带宽,以及高达192GB的HBM3内存(比较之下,H100仅80GB)。

在实践的生成式AI渠道使用中,MI300X被规划为8个一组 ,经过Infinity Fabri进行互联,各GPU之间的吞吐量为896 GB/s。

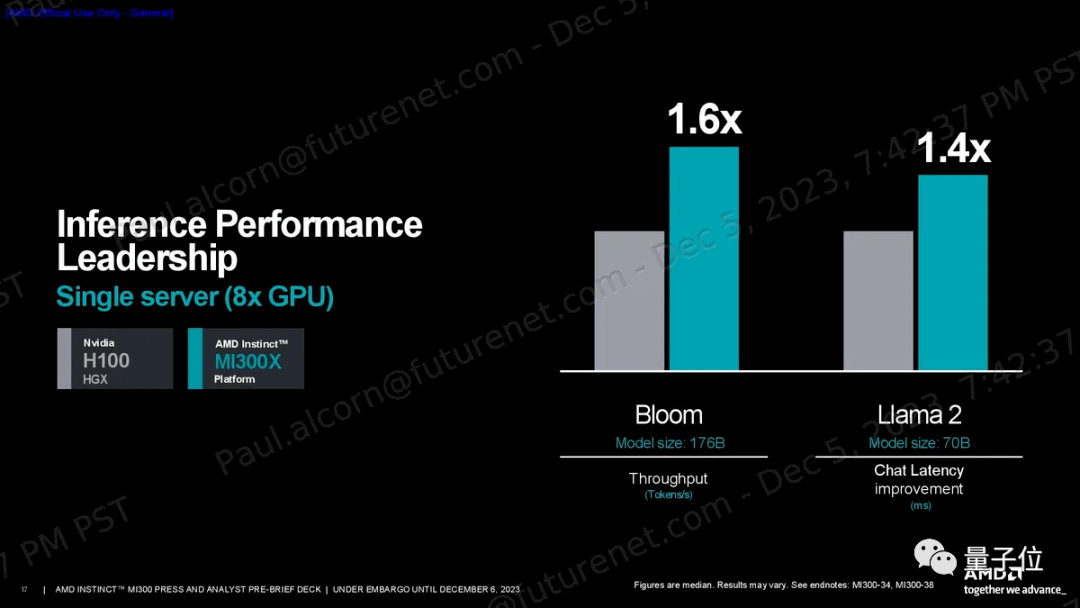

与英伟达的H100 HGX渠道(BF16/FP16)比较,内存总量添加2.4倍,核算才能进步1.3倍。

与此同时,AMD还为MI300X装备了400GbE网络并支撑多种网卡,比英伟达的挑选更多。

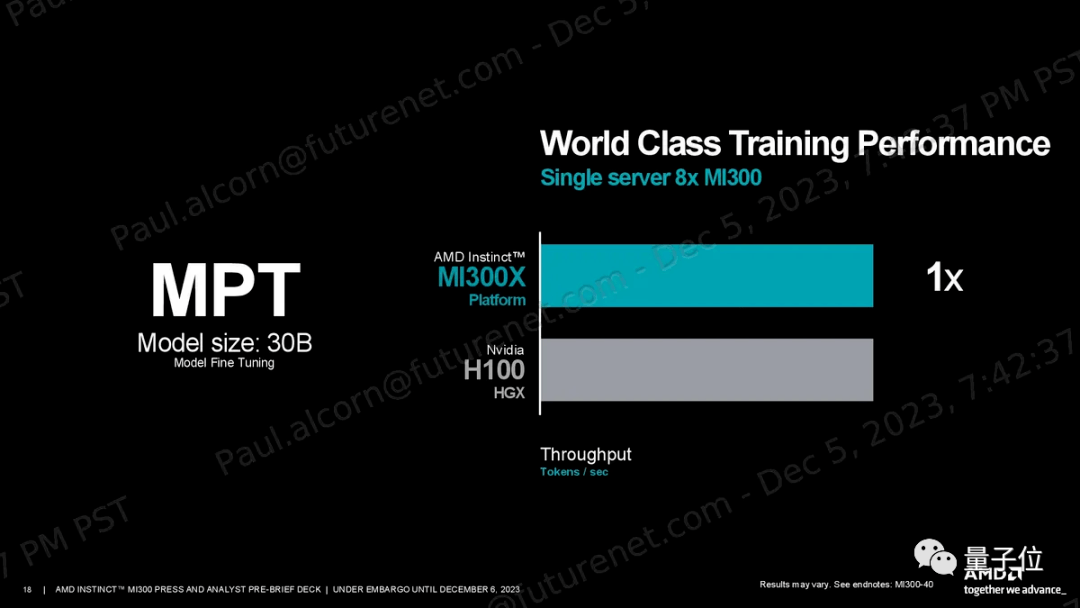

比较之下,在练习使命上,MI300X在300亿参数的MPT上的功能却是与H100 HGX大致相同。

此外,还需要着重的是,MI300X因为内存容量真实更大,因此能包容比H100多两倍的300亿参数练习模型、700亿参数的推理模型。

以及MI300X最多可支撑700亿练习和2900亿参数的推理模型,这都比H100 HGX多一倍。

现在,AMD现已向HPE、戴尔、联想、SuperMicro等原始设备制造商发货,正式出售时刻定于下季度,也便是下一年。

Tomshardware表明,H200在内存容量和带宽方面大概率会更上一层楼,核算功能则估计将和MI300X差不多。

最终,在发布会上,苏妈也猜测,2027年AI芯片总商场将到达4000亿美元。而她以为,AMD有决心从中分走一块还不错的蛋糕(get a nice piece of that)。

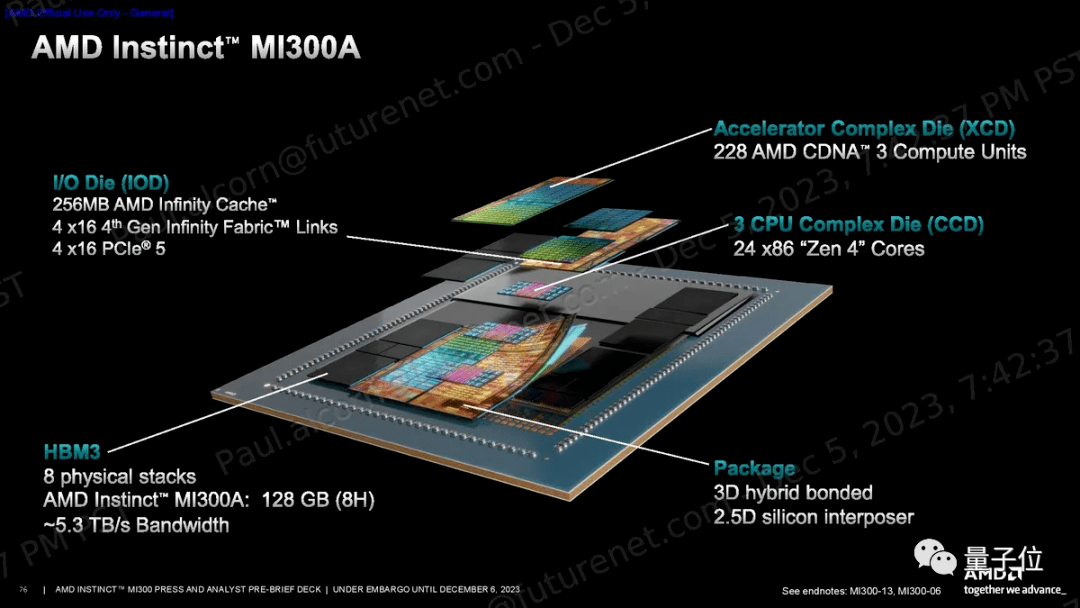

据悉,MI300A是全球首个数据中心APU,CPU和GPU结合在同一个封装之中,对标的是英伟达Grace Hopper Superchips ,后者CPU和GPU坐落独立的封装中,再串联到一同。

详细而言,MI300A选用和MI300X相同的根本规划和办法,但包括3个5nm中心核算芯片(CCD),每个装备8个Zen 4 CPU,所以总共24线核算单元。

内存容量上,比较MI300X中的8个12Hi仓库,它改为8个8Hi仓库,从而将容量从192GB缩减至128G,内存带宽仍为5.3TB/s。

据悉,MI300A已开端用于美国劳伦斯利弗莫尔实验室,根据该芯片,该实验室的El Capitan有望变成全球首台2 Exaflop等级的超级核算机。

详细到模型上,用它练习一个相似GPT-3的1750亿参数模型的功能将进步2.8倍。

电话:400-6368-3518

地址:山东潍坊